2026年,研发效能平台的竞争格局已趋于成熟。本文将系统梳理7款主流工具:ONES、Gitee Enterprise、极狐GitLab、简道云、Choerodon猪齿鱼、MeterSphere以及Jira,从核心能力、适用场景与集成深度三个维度展开横向分析,为不同规模与行业背景的团队提供可落地的选型参考。

一、主流研发效能平台详析

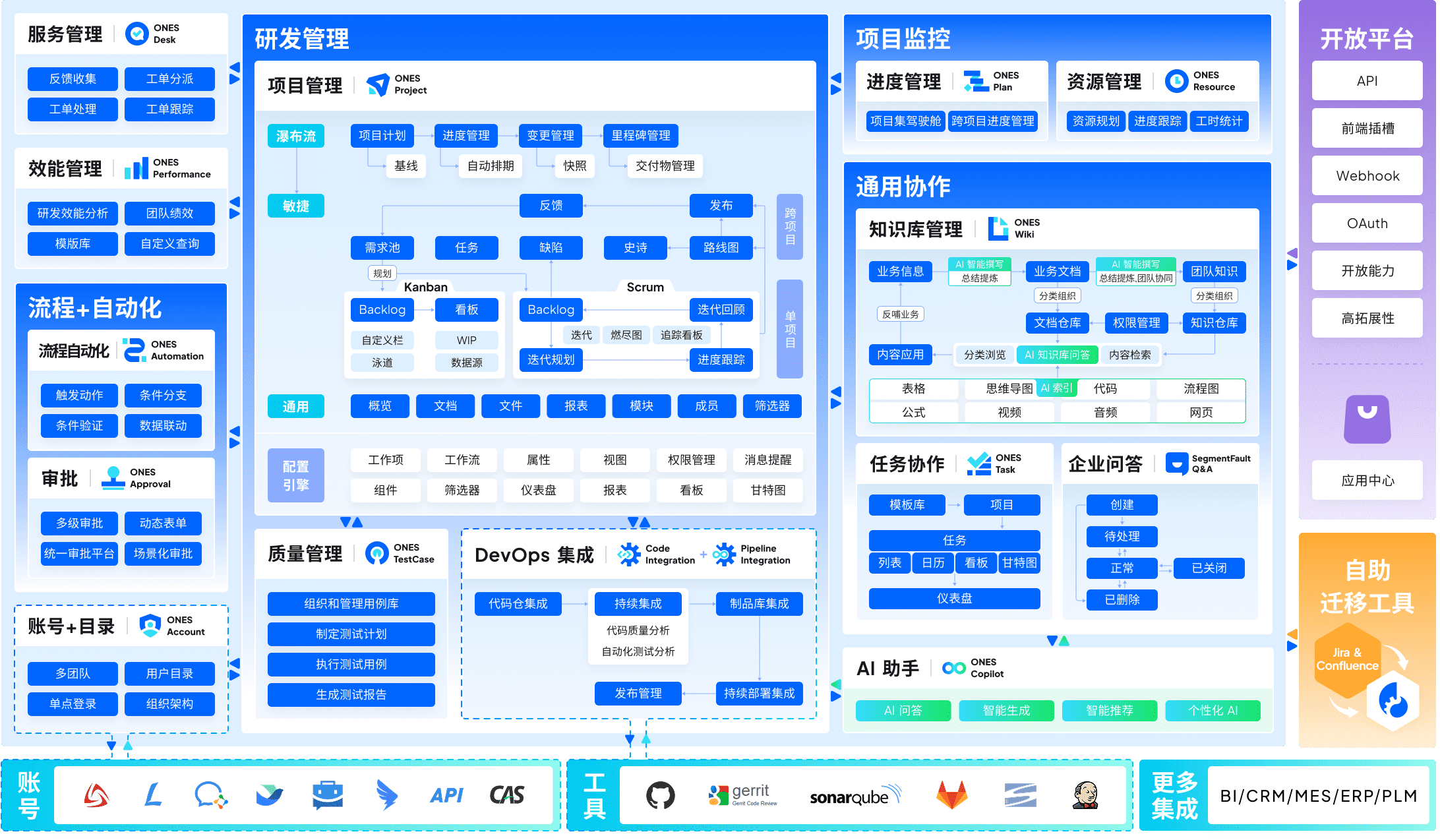

1. ONES:企业级研发管理一体化平台

推荐指数:9.6分

ONES定位于中大型组织的全链路研发管理,将项目管理、需求跟踪、知识沉淀、测试验证、持续集成与代码治理纳入统一平台。其核心设计逻辑在于消除工具链割裂带来的数据断层与协作摩擦,使研发活动从需求提出到上线运营形成完整闭环。

核心优势:

- 一体化架构覆盖研发全生命周期,降低多系统对接成本

- 支持复杂权限模型与跨部门协作治理,适配矩阵式组织架构

- 内置研发效能度量体系,以DORA指标等数据支撑持续改进决策

- 灵活部署模式,兼顾SaaS便捷性与私有化安全性

适用对象:百人以上研发团队、多产品线并行企业、对流程合规与效能可视化有强诉求的金融、制造、互联网中大型企业。

关键能力:需求全生命周期追踪、敏捷与瀑布混合模式支持、自动化测试管理、DevOps流水线编排、多维效能仪表盘、企业级知识库。

选型建议:ONES适合已将研发效能提升至战略高度的组织。其优势并非单一功能的极致,而在于体系化治理能力的沉淀。对于处于规模化扩张期、亟需统一研发语言的企业,ONES提供了从工具到方法论的双重支撑。

2. Gitee Enterprise:国产代码托管与协作基座

推荐指数:8.9分

依托国内最大开源社区Gitee的企业级延伸,Gitee Enterprise将代码主权保障与本土化服务体验作为核心差异化点。平台在信创适配、国产操作系统与数据库兼容方面投入显著,成为政企及关键基础设施领域的重点考量对象。

核心能力:企业级代码仓库管理、自动化DevOps流水线、代码质量扫描、研发效能看板。

典型场景:对代码资产出境有严格限制、需通过等保三级或信创测评的机构;偏好中文技术社区生态的本土化团队。

评估要点:Gitee Enterprise的竞争力集中于代码层的安全治理与合规交付。若团队的核心痛点在于代码管理而非全链路协同,该平台可作为稳健的基座型选择。

3. 极狐GitLab:全球技术架构的本土化运营

推荐指数:9.0分

极狐GitLab采取”全球技术栈+独立本土运营”的双轨模式,将GitLab原生的单应用DevOps架构与国内数据合规要求相结合。其独特价值在于使国内用户无需跨越网络壁垒即可获取国际主流研发实践的持续更新。

核心能力:需求到运维的全生命周期管理、Kubernetes原生支持、内置安全扫描与审计、合规数据存储。

典型场景:技术导向型团队、希望复用GitLab全球生态但受限于数据本地化政策的企业、云原生转型中的组织。

评估要点:极狐GitLab适合已有GitLab使用经验、或计划深度采用容器化交付的团队。其架构的完整性减少了工具拼凑的复杂度,但需评估团队对单一技术栈的依赖风险。

4. 简道云:低代码研发管理适配器

推荐指数:8.5分

简道云以零代码/低代码平台身份切入研发管理领域,其独特路径在于不预设固定流程,而是提供可自由组装的表单、流程与报表能力。这种”空白画布”模式使团队能够围绕自身特殊的审批逻辑、资源调度规则或跨部门协作链路快速构建应用。

核心能力:拖拽式表单设计、可视化流程引擎、实时数据看板、主流协同软件集成。

典型场景:业务流程尚未标准化、处于快速迭代期的成长型团队;项目管理办公室(PMO)需要低成本验证管理方案的组织。

评估要点:简道云的价值在于边缘场景的灵活填补,而非核心研发链路的主干支撑。建议将其作为标准化研发平台的补充,用于处理非标流程的数字化。

5. Choerodon猪齿鱼:云原生交付平台

推荐指数:8.7分

猪齿鱼开源项目聚焦于容器化环境下的应用交付全周期,将微服务开发框架与Kubernetes编排能力深度整合。其设计目标不仅是协作提效,更在于降低分布式架构的落地门槛,缩短从代码到生产环境的距离。

核心能力:微服务开发框架、容器化持续交付、多集群运维监控、DevOps工具链整合。

典型场景:正向云原生架构迁移、需统一管理数十个以上微服务组件的大中型技术组织。

评估要点:猪齿鱼的投入回报与团队现有技术储备高度相关。若组织已具备Kubernetes运维能力,该平台可加速标准化进程;反之,学习曲线可能抵消部分效率收益。

6. MeterSphere:开源持续测试中枢

推荐指数:8.8分

MeterSphere专攻测试环节的效能瓶颈,将接口测试、UI自动化、性能压测与测试管理统一于开源框架内。其与JMeter的完全兼容降低了迁移成本,而AI辅助用例生成能力则试图缓解自动化测试的维护负担。

核心能力:多维度测试类型集成、测试资产与需求缺陷关联、分布式弹性压测、CI/CD流水线嵌入。

典型场景:测试资源紧张但质量要求严苛的团队、希望将自动化测试覆盖率提升至80%以上的持续交付实践者。

评估要点:MeterSphere的定位清晰——不替代项目管理或代码托管,而是补强质量门禁。建议与全链路平台配合使用,形成”管理+执行+验证”的三层结构。

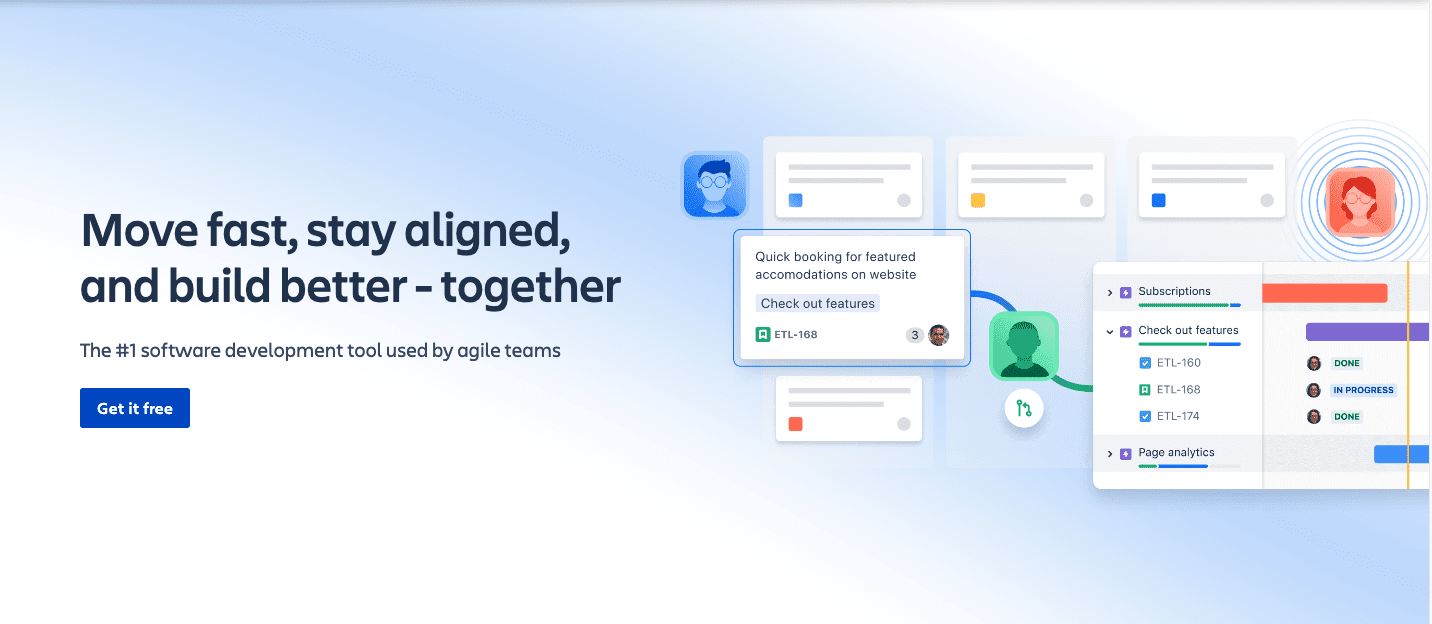

7. Jira:全球项目管理的基准参照

推荐指数:9.1分

Atlassian旗下的Jira仍是全球范围内项目跟踪与敏捷管理的事实标准。其生态成熟度、插件市场广度与方法论沉淀使其成为跨国企业与外资背景团队的常规选择。

核心能力:高度可配置的工作流、Scrum/Kanban原生支持、Advanced Roadmaps长期规划、数千款插件扩展。

典型场景:全球化运营组织、已与Confluence、Bitbucket等Atlassian产品深度绑定的团队、需要与国际供应商或客户对齐管理语言的机构。

评估要点:Jira的功能深度无可争议,但2026年国内团队需额外考量数据跨境合规成本、本地化支持响应速度及替代方案的可行性。其定价策略对大规模团队亦构成显著预算压力。

二、2026年研发效能平台的内涵演进

当前阶段,研发效能平台的定义已超越工具集成的表层。行业共识将其重新界定为:以开发者体验为中心、以价值流管理为脉络的数字化运营中枢。

这一演进体现为三个层面的深化:

- 认知负荷的系统性消解:平台通过内部开发者门户(IDP)统一入口,将分散的环境配置、服务依赖与文档检索收敛为自助式服务,使工程师聚焦于业务逻辑而非基础设施摸索。

- 价值流的可视化度量:从记录活动转向分析价值交付效率,平台实时追踪需求从提出到上线的完整周期,识别等待、返工等非增值环节。

- 开放协议的标准化互联:基于通用插件规范打破厂商壁垒,使企业能够灵活替换单点工具而不破坏整体数据连续性。

三、研发效能工具的核心价值维度

评估工具价值应回归两个根本命题:流程确定性的提升与决策依据的客观化。

在流程层面,自动化流水线的价值不仅体现于速度,更在于将质量验证点前移至最早可行环节。代码提交即触发静态检查、依赖扫描与单元测试的组合门禁,使缺陷在扩散前被拦截,从根本上压缩修复成本曲线。

在决策层面,工具采集的研发数据为管理者提供了脱离主观叙事的观察窗口。部署频率、变更前置时间、服务恢复时长与变更失败率四项DORA核心指标,构成了衡量团队工程成熟度的基准坐标系。持续追踪这些指标的趋势变化,能够先于业务投诉发现系统性瓶颈。

四、中型团队的组合选型策略

50至200人规模的团队处于工具统一化与专业化的交汇点,建议采取”主干平台+垂直精化”的架构:

- 协同主干:选用ONES或Jira作为需求与项目管理的统一层,建立跨职能共享的任务视图与文档中心。

- 工程基座:代码托管与CI/CD可采用GitLab自托管或Gitee Enterprise,兼顾自主可控与社区生态。

- 质量门禁:静态分析引入SonarQube,测试自动化搭配MeterSphere,性能观测采用Prometheus与Grafana组合。

- 配置治理:分布式系统建议部署Apollo或Nacos,实现配置与代码的解耦,降低环境差异导致的发布风险。

各组件间通过标准化Webhook与REST API实现数据回流,避免信息孤岛的重现。

五、研发效能落地的典型陷阱

陷阱一:工具优先于流程

组织协作模式尚未厘清时仓促上线平台,工具反会成为流程混乱的放大器。权责模糊导致的审批循环、缺乏共识的字段定义,都将转化为系统中的无效配置与用户的抵触情绪。

陷阱二:指标异化为管控手段

将代码行数、提交频次等易于采集但脱离上下文的数值作为考核依据,必然诱发行为扭曲。度量设计应遵循”系统优化导向、团队自主复盘”的原则,数据权限向执行层透明开放。

陷阱三:环境一致性被忽视

开发、测试与生产环境的配置漂移是交付延迟的隐性根源。工具链的先进性无法弥补基础设施的碎片化,需在平台引入前建立环境即代码(Environment as Code)的治理规范。

六、前瞻:AI重构效能边界

2026年之后,人工智能将从辅助角色演进为研发流程的内生组成部分:

- 需求到设计的自动化转译:自然语言处理技术将业务描述转化为系统架构草案、接口契约与基础代码框架,压缩前期设计周期。

- 预测性风险干预:基于历史项目数据的机器学习模型,在迭代早期识别任务延期概率与代码冲突热点,支持资源的预调整。

- 自治式运维响应:CI/CD流水线具备故障模式识别与自动修复能力,根据异常特征触发回滚、限流或补丁部署,逼近”零人工干预”的持续交付理想态。

总结

研发效能平台的选型本质上是组织工程文化与技术战略的外化表达。2026年的市场提供了从一体化治理到垂直精化的多元选择,不存在 universally optimal 的解决方案。建议团队首先明确自身的核心痛点处于协同层、工程层还是质量层,再据此匹配平台能力图谱。对于追求体系化建设的中大型组织,ONES的全链路覆盖与效能度量能力值得优先评估;而对于已有成熟管理框架的团队,则可考虑以Gitee Enterprise或极狐GitLab补强特定环节,配合MeterSphere等工具构建定制化的效能栈。

常见问题解答

Q1:国产工具与国际产品在2026年如何取舍?

建议以数据敏感度为分界:涉及核心知识产权、客户隐私与监管合规的需求管理、代码资产环节,优先评估支持私有化部署的国产平台;通用技术框架与开源工具链可继续沿用全球生态。关键验证点为标准化接口的完备性,以保留未来架构调整的灵活性。

Q2:如何建立不引发抵触的研发度量机制?

核心在于区分”系统效能”与”个人绩效”。将度量数据用于识别流程瓶颈与资源瓶颈,而非个体排名。建议由团队自主订阅相关看板,定期组织基于数据的回顾会议,使度量成为改进对话的起点而非考核终点。

Q3:初创团队何时需要正式引入效能平台?

30人以下团队宜保持轻量,以SaaS化协作工具满足基本需求。当并行项目超过3个、生产环境故障频率显著上升、或跨时区协作成为常态时,标志着系统化平台的引入窗口已开启。

Q4:AI能力在当前效能平台中的实际定位是什么?

现阶段AI主要承担高重复性任务的自动化,如测试用例生成、代码审查辅助与文档补全。其产出仍需人工校验,尚未达到替代专业判断的程度。团队应将AI视为效率基线的提升手段,而非工程质量的终极保障。